Les fondements de ce qu’on appelle aujourd’hui l’Intelligence Artificiel remontent à une époque où elle n’a été que conceptualiser. Dès 1943, ce qu’on appelle « réseau de neurones artificiels » est inventé : un système matériel/logiciel dont le fonctionnement se calque sur celui du réseau de neurone humain (et qui servira à l’IA actuelle). Mais commençons plus simplement par quelques points clés de la petite histoire de l’IA, et ça démarre dans les années 50.

Le terme d’Intelligence Artificiel apparaît en 1956 de la part de John McCarthy, mathématicien et informaticien, lors d’une conférence (conférence de Dartmouth). Il a notamment obtenu le prix Turing (ACM Turing Award) en 1971, considéré comme une sorte de prix nobel de l’informatique, pour ses travaux en intelligence artificielle.

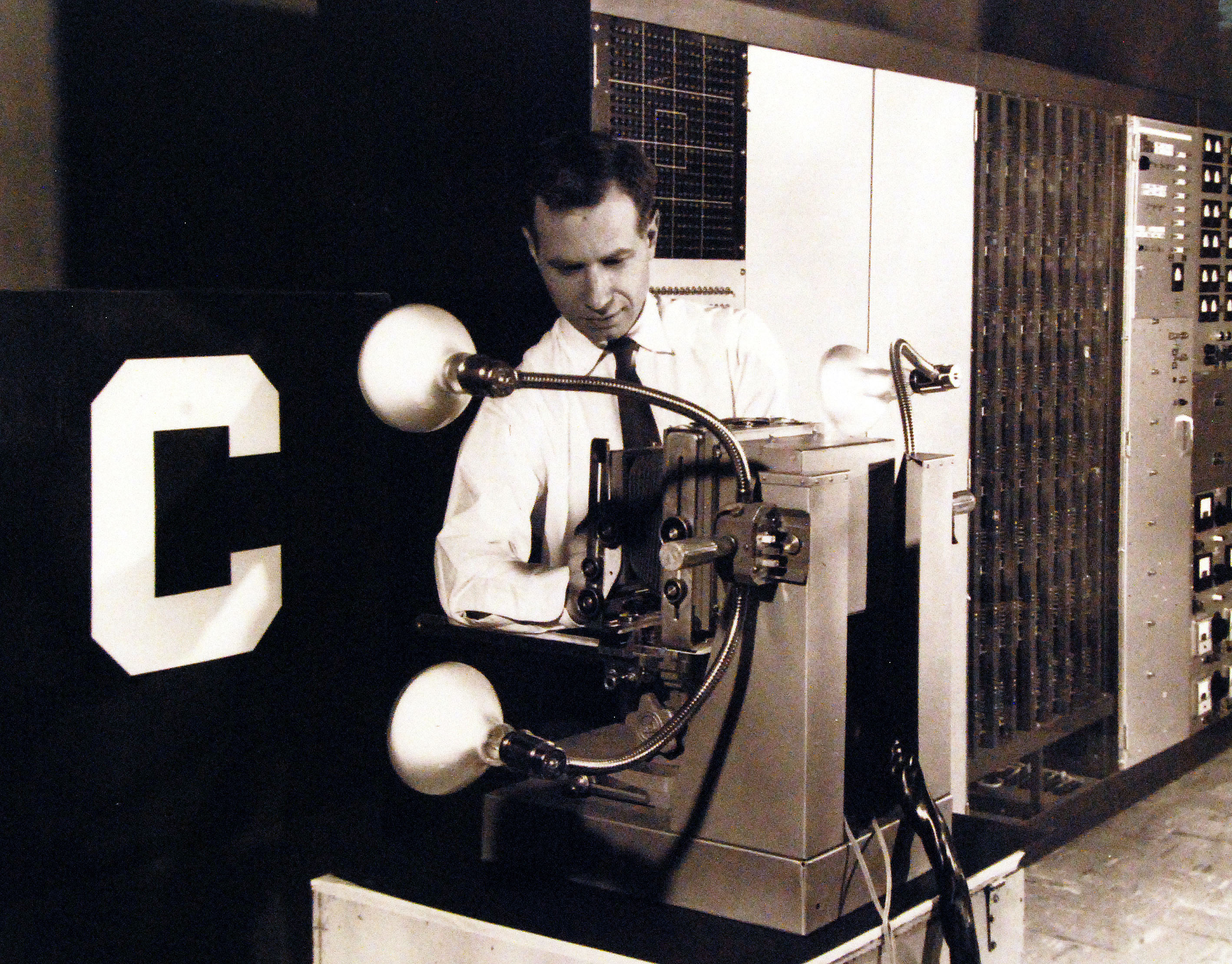

En 1957, le Perceptron, un algorithme de machine learning (qui donne aussi son nom à la machine qui l’utilise), se montre capable de discerner un visage d’homme ou de femme à partir d’une photo fournit. Il est une des premières applications connues et concrète d’Intelligence Artificielle et dont le mode d’apprentissage est encore utilisé aujourd’hui.

Puis dans les années 70 sont mis en place les OCR (Optical Caracters Recognition) pour l’utilisation dans les entreprises postales (d’abord Américaine). Basé sur les mécanismes de l’Intelligence Artificielle, c’est ce qui permet aux machine de tri de courrier de reconnaitre les lettres, et donc les adresses, et ainsi de les répartir.

Autour de 1980 c’est la naissance des réseaux de neurones convolutif. C’est cette architecture de réseau de neurone artificiel qui permettra la prise en charge d’énorme montant de données (la donnée étant le carburant d’une IA) et des applications dédiées aux images.

En 1990, Yann Le Cun, aujourd’hui figure renommée dans le domaine de l’IA, développe LeNet, réseau de neuronne reconnaissant les caractères manuscrit sur les chèques.

En 1996 puis en 2015, ce sont « Deep Blue » d’IBM et « AlphaGo » de Google DeepMind qui battent respectivement des champions d’échec et du jeu de go. Ces IAs ont profité des méthodes d’apprentissage connus (supervisées) mais aussi des méthodes d’apprentissage par « renforcement » : l’IA reproduisant des parties pour en déduire les mouvements les plus adaptés à chaque situation.

DeepBlue, référence populaire

Le nom DeepBlue fait référence à deux chose : « Big Blue », le surnom d’IBM, et « DeepThought (« Pensées Profondes » en Français) le nom du super ordinateur dans la saga « Guide du Routard Galactique » (The Hitchhiker’s Guide to the Galaxy – H2G2), saga dont on tient les références régulière au chiffre « 42 ».

En 2018, l’IA d’Alibaba surpasse les humains au Test de turing (tests visant à révéler, par les réponses fournies, qui des deux testés est un humain ou un IA), test conçu à partir du dataset de référence SQuAD (Standford Question Answering Dataset).

Dés 2020, des LLMs (Large Language Model, spécialisée dans la manipulation du langage humain) apparaissent : le projet Galactica de META permet de « converser » avec une IA dédiée aux recherches scientifique tandis que GPT-3 est rendu disponible au grand publique via l’application ChatGPT. Et depuis les avancées dans le domaine se multiplient.

Nous sommes dans l’ère de la démocratisation des IAs. Après un démarrage lent, fait de conceptualisation des mécanismes que l’on prète à l’IA et expérimentations limitées par la puissance informatique de l’époque, les choses s’accélèrent.

Mais finalement, qu’est-ce qu’on appelle une IA ? comment fonctionne-t-elle ?

Sources

- https://fr.wikipedia.org/wiki/Histoire_de_l%27intelligence_artificielle

- https://fr.wikipedia.org/wiki/John_McCarthy

- https://openclassrooms.com/fr/courses/6417031-objectif-ia-initiez-vous-a-lintelligence-artificielle

- https://www.france.tv/documentaires/documentaires-societe/l-homme-a-la-machine/6931306-episode-1-les-chemins-de-l-apprentissage.html

- https://www.linkedin.com/pulse/comment-la-poste-utilise-lintelligence-artificielle-pour-k%C3%A9vin-garel/

- Perceptron – Wikipedia

- https://rajpurkar.github.io/SQuAD-explorer/

- Revue Historia Octobre 2024 : https://boutique.historia.fr/produit/intelligence-artificielle-histoire-dune-revolution